背景(Background)

创新点(Highlights)

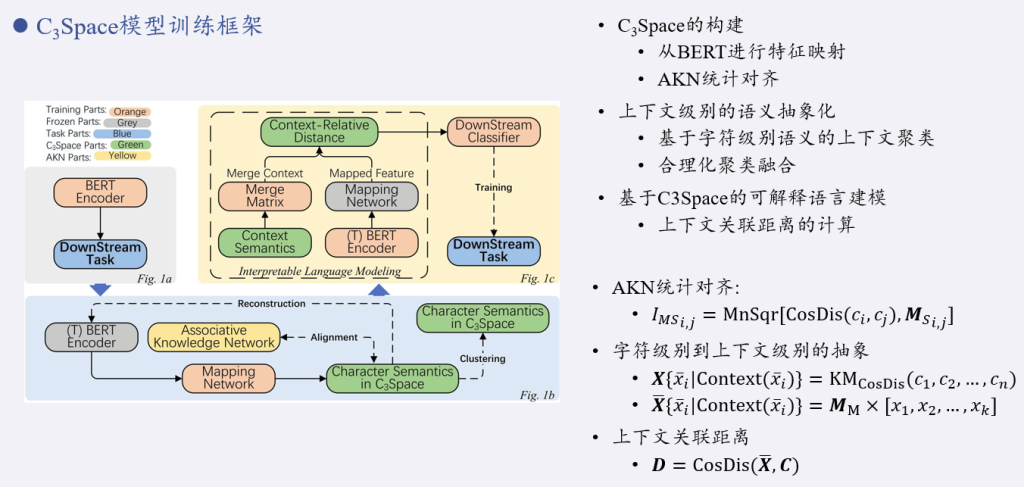

方法(Methodology)

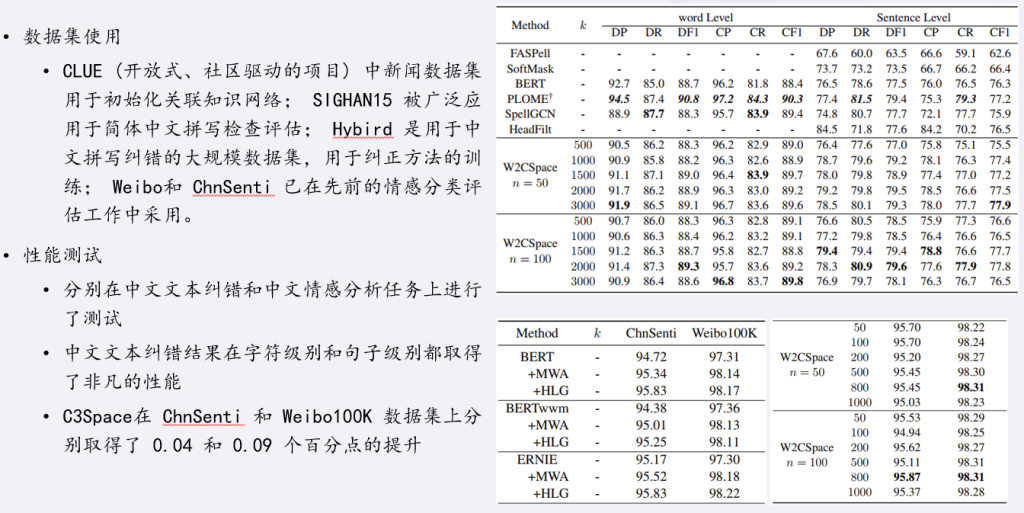

实验(Experiments)

结论(Conclusion)

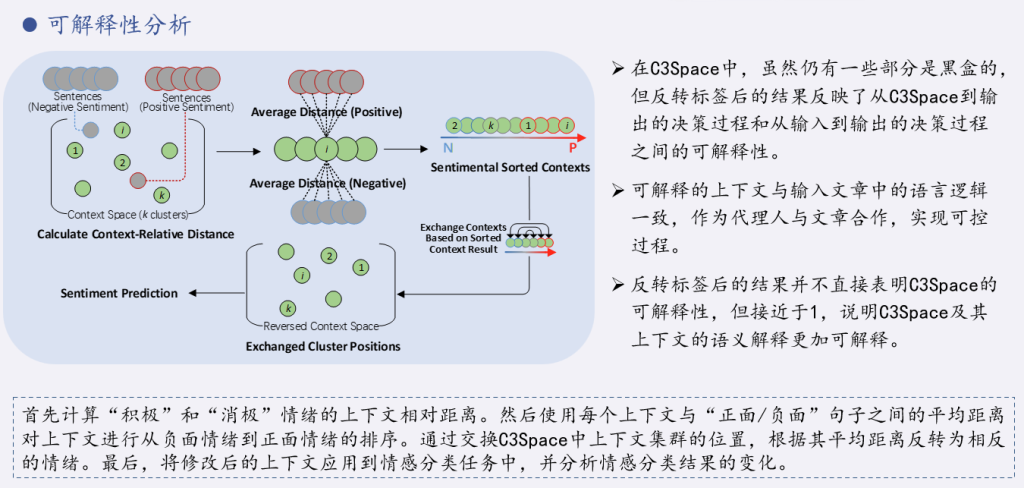

本研究通过构建词-语境耦合空间,提出了一种可解释语言模型。在W2CSpace中,(1)BERT中不可解释的神经表示受可解释的关联知识关系调节,(2)设计具有合理可解释语义的中间表示空间,(3)在中间表示空间的基础上为下游分类器引入可解释的语义特征。显然,上述策略为可解释的预训练语言建模过程带来了较强的泛化能力。此外,为了预防潜在风险,引入了可解释的机器学习方法,将不利影响从黑箱结构中迁移出来。此外,在我们的方法中,可控决策过程通过控制相关上下文来实现对非法语言输入的调节,预训练模型与W2CSpace之间的强协作可以保护参数隐私不被数据窃取。